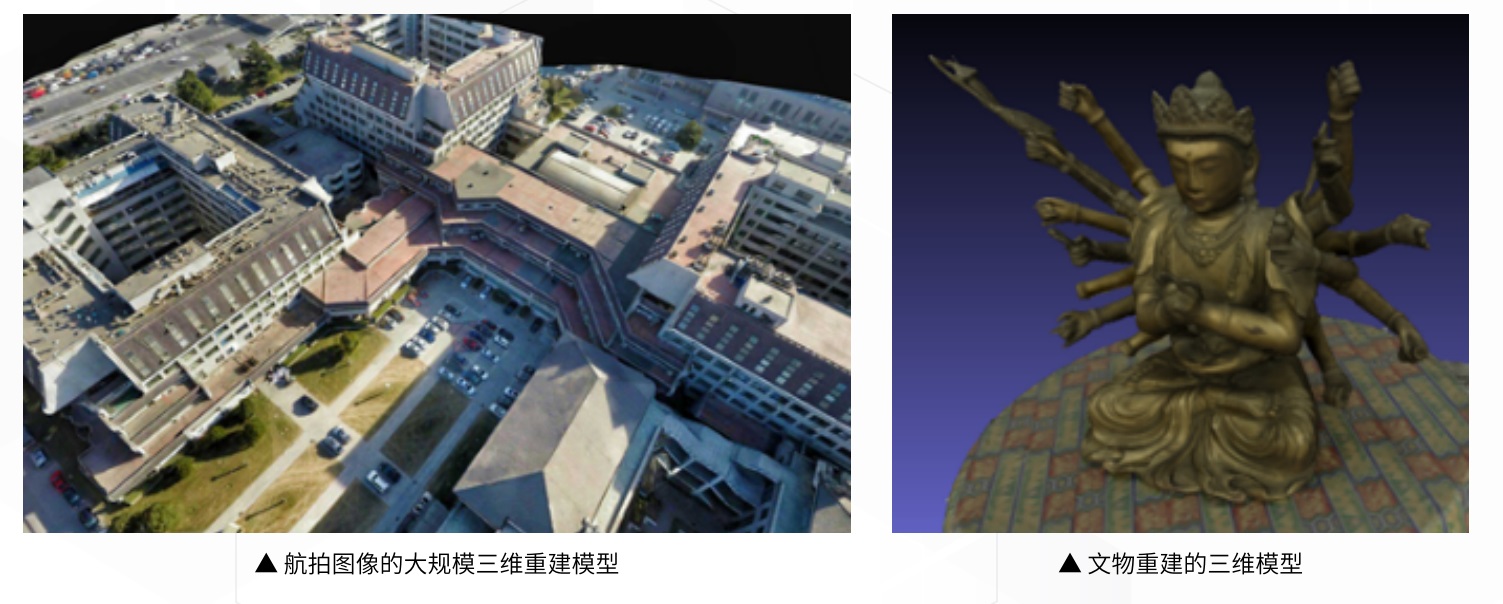

基于分布式架构的大规模三维重建:使用基于图像和视频的三维重建技术进行针对3D模型的精细重建以及最新的分布式架构针对大规模城市场景的快速三维重建,自主研制了二三维重建系统i23D,系统包括从数据采集到场景处理组织存储显示的全流程技术体系。系统工具被用于多个博物文物和智慧城市的三维场景快速重建中,并提供在线的三维场景重建服务。

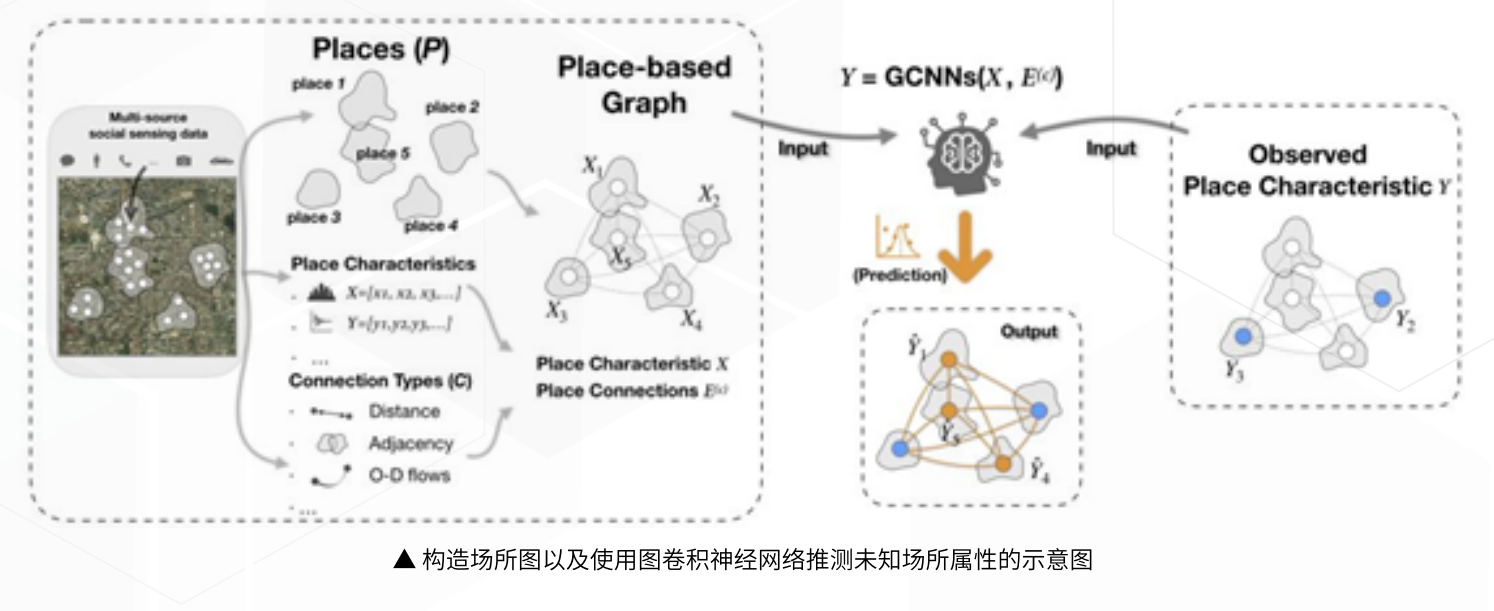

图卷积神经网络(GCNN)应用于不规则的地理空间分布的建模和推测:提出场所图(placebased graph)对复杂的场所属性和多源的场所连接进行形式化表达,通过训练图卷积神经网络(graph convolutional neuralnetwork, GCNN)实现地理空间回归 ,充分挖掘地理语境中场所属性的可预测性知识。本研究为不规则的地理空间分布提供了一种全新的神经网络建模思路,可以用于辅助评估空间模式,衡量城市 社会经济发展与人类活动的关系,进而指导城市规划和居民生活。论文于2020年1月正式发表于国际地理学旗舰刊物Annals of the American Associa tionofGeographers。

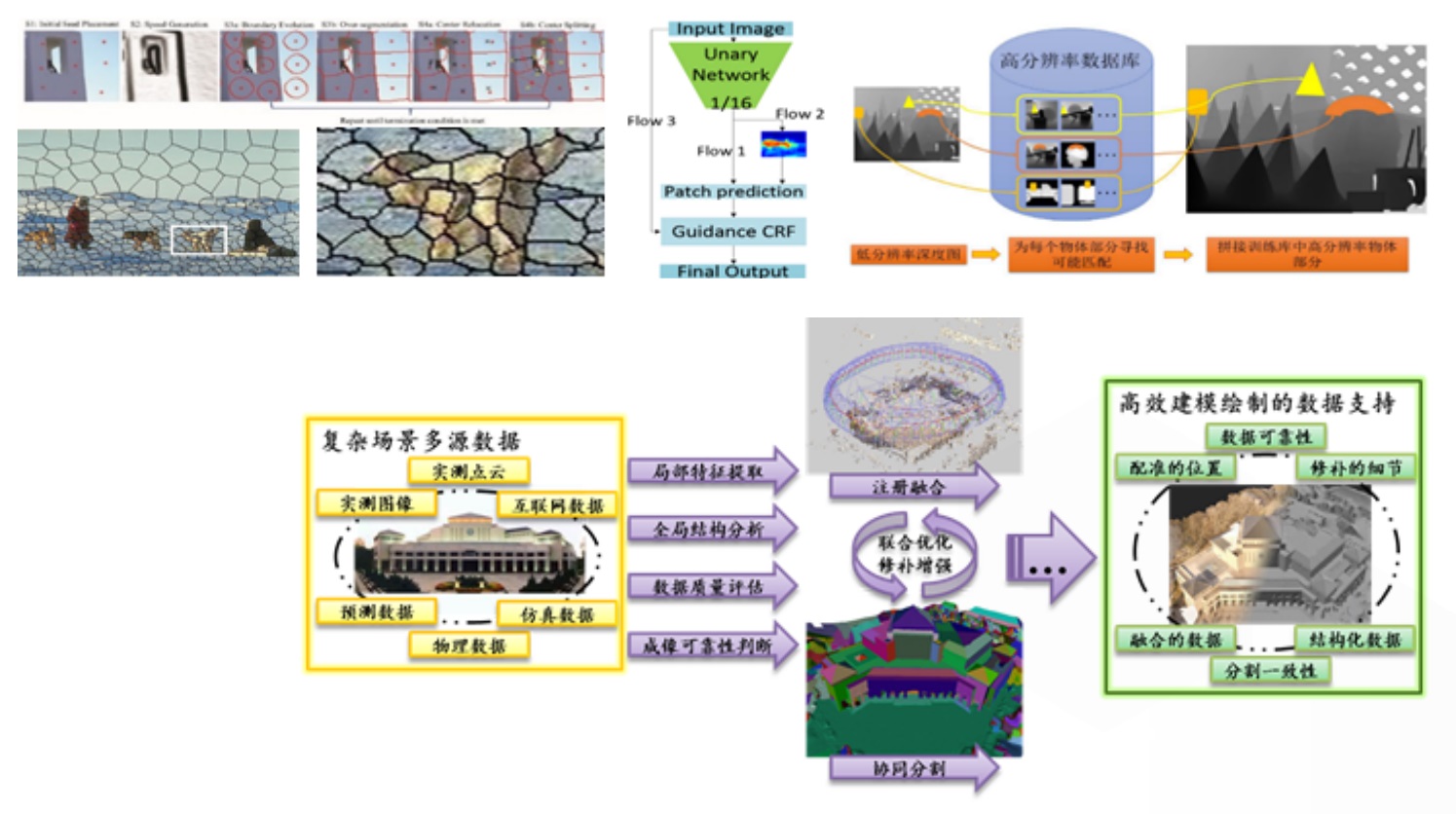

基于结构分析的场景建模:针对场景建模和绘制在鲁棒性、精度和计算效率方面的问题,从加强输入数据的类型、规模和质量入手,研究来自实测和社会的多源异构场景数据的结构化分析方法,引入仿真、预测、物理数据,挖掘在布局、构成、形变和互动等方面更多的结构约束,探索多源数据协同分割和语义识别方法。该尝试在统一的理论框架下表达数据融合、分割识别和几何重建的研究目标,有助于对问题形成更全面和完善的理解,并在理论上保障算法结果的最优性,通过多源数据协同分割识别与几何模型的联合优化提高结构分析和场景重建的一致性,更好地支持数据驱动智能化场景建模和绘制。

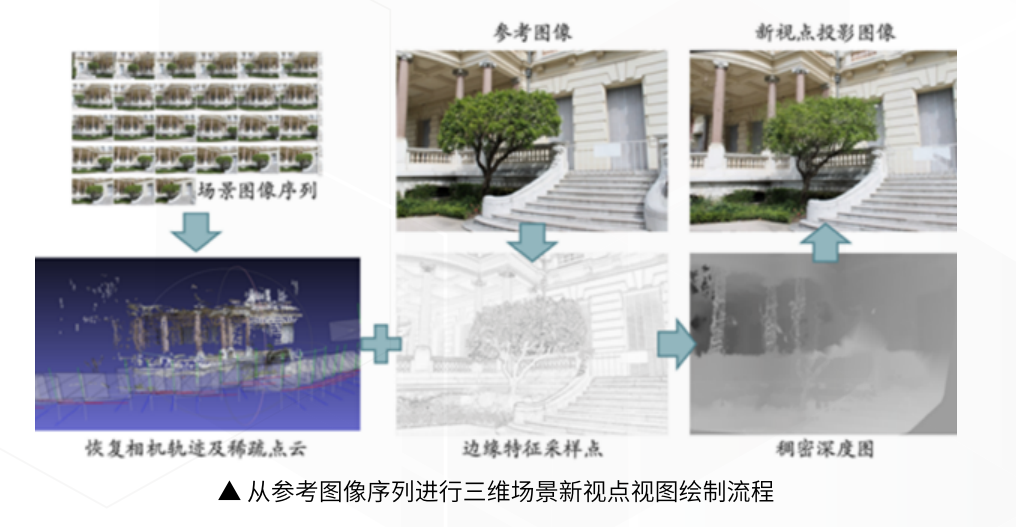

基于图像的三维场景高效建模与绘制:以通用相机获取的场景参考图像序列为输入,结合重要性采样等方法,充分利用参考图像中的颜色、纹理、边缘等特征,将稀疏的深度信息在图像平面上进行传播,从而快速、准确地恢复出稠密深度图像。在此基础上实现了在任意新视点下快速生成照片真实感新视图的方法。该方法仅需利用普通相机拍摄参考图像,对输入设备和数据具有更少的限制,应用范围也更广泛。